是因为lr设置的不好吗?iou thresh从哪里设置呢?

-

centernet训练自己的数据集出现过量高score框并且有误检

-

刘看山 |

@LDoubleZhi 原作者的版本实际上内核和我们都是一样的,我们需要改 classes的配置,原作者也要改,如果你要训练自己的数据集的话。我们其实提供一个训练trafficlight的示例工程,可以参考

-

BUAAtao |

-

@金天 我好像找到原因了,demo_det_r010_custom.py里heads = {'hm': 5, 'reg': 2, 'wh': 2}中的hm要根据自己的类设置,哭了,搞了一周

-

@金天 我用demo.py和demo_det_r010_custom.py得到的结果不一样,是不是后者代码有问题

-

@金天 问题汇总一下:1.是否需要像原作者一样把torch中的bn disable 2.奇异ai的工程主要改了哪个python文件,如果想把作者的最新代码更新到里面时不能覆盖那些文件。 一样的数据集一样的超参数用奇异ai的训练效果太差啊

-

此回复已被删除!

-

此回复已被删除!

-

@金天 我晚上完全把opts debugger coco_custom.py和原项目匹配一下(超参数,和类别设置),训练看看结果,要是还有误检就说明代码有问题,同样的数据集我用xingyizhou的代码训练的模型效果很好

-

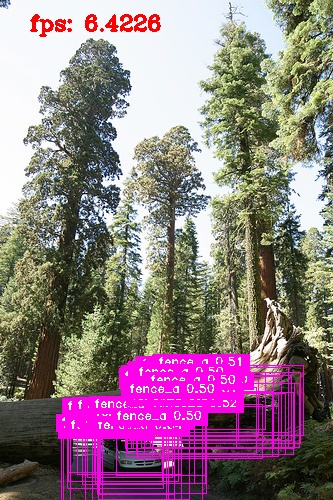

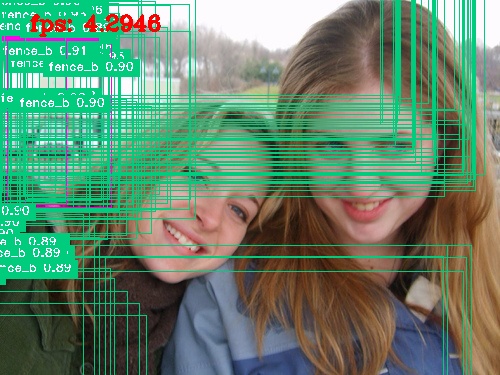

@金天 这个完全是误检了,把人和车识别成fence_a

-

@金天 原作者的project需要disable cudnn batch normalization,奇异ai的需要吗?

-

刘看山 |

@LDoubleZhi 缺少了nms,更新一下最新的代码,MANAAI的centernet针对onnx导出做了一些改动,理论上默认是关闭的,可以pull一下最新的更新。

-

@金天

这两个分别是我用annaai和原作者centernet训练的结果,coco格式数据集完全一样,不知道什么原因 -

刘看山 |

先排除一下数据本身的问题,看看是coco的format, visualize出来看一下。

网络本身训练问题不大

-

(图片

地址)

地址)train: [88][81/82]|Tot: 0:03:23 |ETA: 0:00:03 |loss 0.8437 |hm_loss 0.4320 |wh_loss 1.9508 |off_loss 0.2166 |Data 0.020s(0.035s) |Net 2.479s

ctdet/default |################################| train: [89][81/82]|Tot: 0:03:22 |ETA: 0:00:03 |loss 0.8449 |hm_loss 0.4285 |wh_loss 1.9778 |off_loss 0.2186 |Data 0.020s(0.033s) |Net 2.475s

ctdet/default |################################| train: [90][81/82]|Tot: 0:03:23 |ETA: 0:00:03 |loss 0.8749 |hm_loss 0.4565 |wh_loss 2.0108 |off_loss 0.2173 |Data 0.020s(0.034s) |Net 2.476s

ctdet/default |################################| val: [90][296/297]|Tot: 0:00:26 |ETA: 0:00:01 |loss 1.3022 |hm_loss 0.8241 |wh_loss 2.6082 |off_loss 0.2173 |Data 0.000s(0.001s) |Net 0.089s

model_90.pth is saved!loss降到1以下了,但检测结果非常差